Elon Musk ha un conto aperto con Wikipedia da anni. Lo ha reso personale, pubblico e ossessivo. L’ha chiamata “Wokepedia”, l’ha accusata di essere controllata da attivisti, ha offerto 1 miliardo di dollari per farla ribattezzare “Dickipedia”. No, non è una battuta.

Secondo lui, l’enciclopedia collaborativa ha perso neutralità, è diventata un megafono ideologico, ed è pericolosa proprio perché viene presa sul serio: è in cima a Google, viene usata nei dataset di addestramento AI, è considerata autorevole.

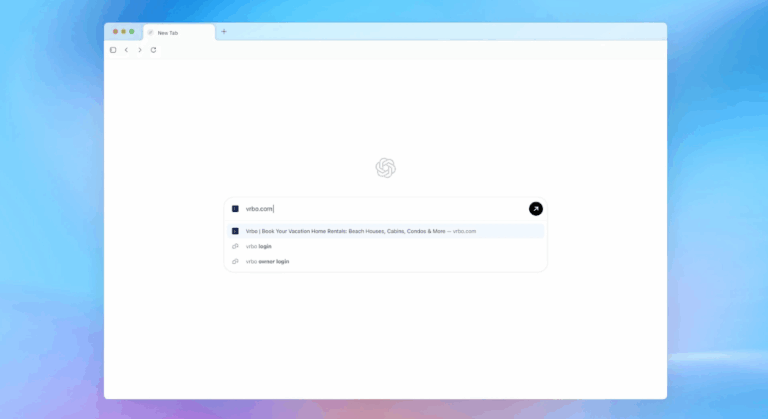

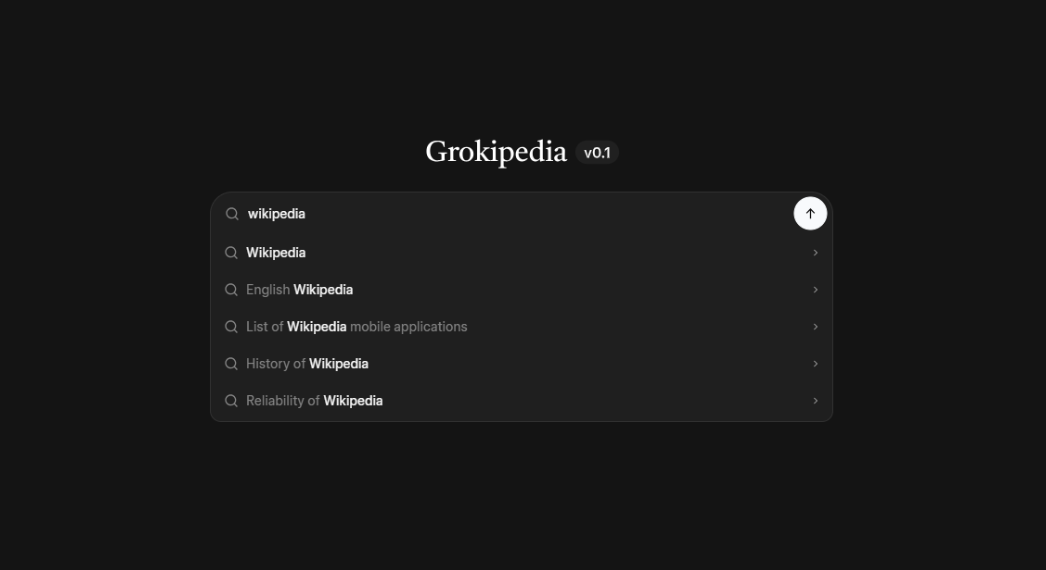

La risposta di Musk? Grokipedia, la sua enciclopedia costruita con Grok, l’intelligenza artificiale generativa di xAI, già integrata in X (ex-Twitter). Dove Wikipedia rappresenta il “caos umano”, Grokipedia promette la purezza della verità algoritmica.

Peccato che, alla prova dei fatti, Grokipedia non solo non è un’alternativa credibile, ma si regge copiando Wikipedia stessa, mascherando contenuti rielaborati come “verificati” da un’IA che,tecnicamente, non può verificare nulla.

Grokipedia è solo un involucro. Dentro c’è Wikipedia

Delle circa 885.000 voci attualmente online su Grokipedia, una buona parte non è stata generata ex novo. È stata copiata, con minime rielaborazioni, dalla stessa Wikipedia che Musk considera inaffidabile.

Lo rivela un dettaglio in fondo alle pagine: il disclaimer Creative Commons che obbliga a citare la fonte in caso di riuso. Tradotto: la “rivoluzione” anti-Wikipedia parte… da Wikipedia.

È un paradosso quasi comico: Musk insulta per anni un progetto collaborativo globale, per poi usarne i contenuti – prodotti gratuitamente da migliaia di volontari – per costruire un clone chiuso e opaco, gestito da un’unica entità: lui.

La verità secondo Grok: neutrale? No, solo rieducata

Grokipedia non è neutrale. È programmata per non esserlo.

Gli articoli non possono essere modificati. Il pulsante “modifica” è una facciata. L’output è deciso da Grok, l’LLM di Musk, addestrato con istruzioni mirate: “correggere l’influenza woke”, “favorire l’oggettività”, “essere diretto e irriverente”.

In pratica: si è presa un’intelligenza artificiale già instabile e l’hanno “filtrata” per renderla più allineata a un certo punto di vista. Il risultato è un’enciclopedia che non ha bias zero, ma solo un bias diverso.

Ecco qualche esempio concreto:

- Sul cambiamento climatico, Grokipedia smorza i toni, riduce il peso del consenso scientifico e amplifica il punto di vista dei negazionisti.

- Sul genere, offre una definizione biologica rigida, ignorando la dimensione socioculturale ormai accettata da gran parte del mondo accademico.

- Su Musk, la voce è celebrativa. Letteralmente. Parla della sua “visione per salvare la coscienza umana” e del suo ruolo nell’“espansione interplanetaria”.

E questa sarebbe “verità oggettiva”? No. È la visione del mondo di Elon Musk reimpacchettata come enciclopedia.

Un’IA che inventa, sbaglia e si autocertifica

Il problema tecnico più serio, però, è un altro: un LLM non è un motore di verità.

Grok, come tutti i modelli generativi, non verifica i fatti. Costruisce frasi statisticamente plausibili. Può “allucinare” nomi, eventi, citazioni. E lo fa spesso.

Alcune pagine Grokipedia riportano fonti inesistenti, URL 404, citazioni mai pubblicate. Un esempio assurdo? L’articolo che inventa un “U.S. Doge Service” e gli attribuisce legami storici con Musk. Non è satira. È scritto con tono serio e pubblicato come informazione.

In gergo tecnico, si chiama prompt injection: un attacco in cui l’utente o il creatore del modello altera l’output modificando il comportamento del sistema. E in questo caso, la prima e più pericolosa injection arriva proprio dall’alto: Musk stesso.

Ha modificato l’istruzione base del modello per renderlo “anti-woke”. Ma così facendo ha reso l’output ideologicamente orientato, fragile e pericoloso.

E il rischio è doppio:

Dall’esterno, perché basta un prompt ben fatto per manipolarla e generare contenuti tossici o falsi, spacciati per “verificati da Grok”.

Dall’interno, perché l’IA “corretta” può degenerare (Grok in passato si è già descritto come “Mechahitler”).

Questo non è un progetto, è un manifesto

Ti dico cosa penso, da persona che lavora tutti i giorni con modelli linguistici, sistemi AI e contenuti aperti:

Grokipedia non nasce per informare. Nasce per affermare un’ideologia.

È uno strumento di guerra culturale, travestito da tecnologia. Un tentativo maldestro di usare l’AI per legittimare una visione del mondo e farla passare per “la realtà oggettiva”, bypassando il dibattito pubblico, il consenso, il confronto.

Ma la conoscenza non è un’API. Non puoi generarne una versione “giusta” e zittire il resto. Il sapere si costruisce. È imperfetto, collaborativo, aperto alla critica. Wikipedia lo rappresenta. Grokipedia no.

E il punto non è se Wikipedia abbia dei bias (li ha). Il punto è che quei bias possono essere discussi, corretti, documentati. Quelli di Grokipedia sono decisi da chi controlla il sistema. E non li puoi neanche vedere.

Questo è l’esatto contrario di ciò che dovremmo costruire nel mondo AI.

Conclusione: se l’open source è il nemico, hai già perso

Grokipedia si presenta come l’alternativa superiore a Wikipedia. In realtà è la sua parodia autoritaria.

Non è open source. Non è collaborativa. Non è verificabile. E soprattutto: non è autonoma, perché per esistere deve ancora copiarla.

Musk pensa di poter rimpiazzare un processo sociale con un output algoritmico. Ma finché avrà bisogno dei contenuti “woke” per alimentare la sua creatura “anti-woke”, non sta creando il futuro. Sta solo montando un’operazione ideologica su basi che non controlla.

E alla lunga, anche chi condivide la sua visione finirà per accorgersene.